如何通过AMD显卡体验Meta Llama 3

AMD的AI战略侧重于通过广泛的训练和推理计算引擎组合、开放和成熟的软件功能来实现生态系统,并通过共同创新来培育AI生态系统。我们将继续专注于使每个人都能使用下一代AI模型,并使各行各业从AI中获益。

我们对Meta最近发布的Llama 3模型非常振奋。Llama 3是Meta迄今为止功能最强的开源模型,在HumanEval、GPQA、GSM-8K、MATH和MMLU基准测试中取得了强悍的成绩。Llama 3有80亿和700亿参数模型,前者适用于客户端用例,后者适用于更多的数据中心和云用例。

好消息是,拥有基于Ryzen AI的AI PC或AMD Radeon 7000系列显卡的AMD客户,无需任何编码技能,即可完全在本地体验Llama 3。

AMD 锐龙7040系列移动处理器(除锐龙5 7540U和锐龙3 7440U之外)和AMD 锐龙 8040系列移动处理器(除锐龙5 8540U和锐龙3 8440U之外)内置了专为处理新兴的AI工作负载而设计的神经处理单元(NPU)。NPU算力最高达16 TOPs,允许用户以卓越的电源效率执行AI工作负载。AMD Ryzen AI APU还包括CPU和iGPU,用于处理按需任务。

在本文中,我们将演示如何在AMD硬件上快速轻松地运行Meta的Llama 3 Instruction 80亿参数模型。

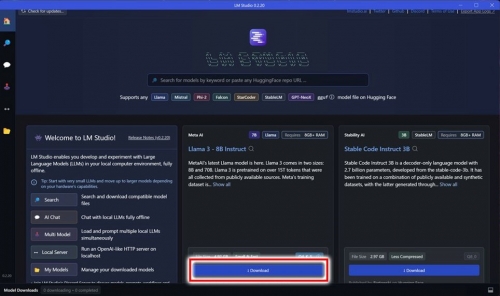

1. 下载LM Studio的正确版本:

|

AMD 锐龙处理器版 |

AMD Radeon RX 7000 系列显卡版 |

2. 运行该文件。

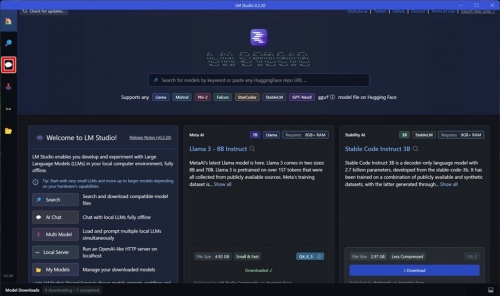

3.点击Llama 3 - 8B指示卡上的“Download(下载)”按钮。

4. 下载后,单击屏幕左侧的聊天图标。

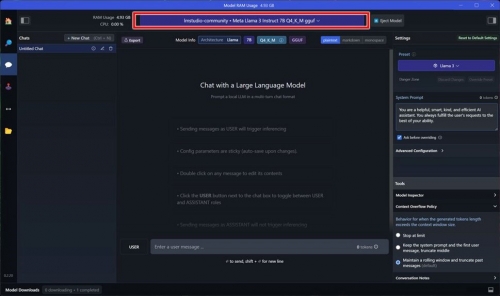

5. 从顶部中间的下拉列表中选择Llama 3。

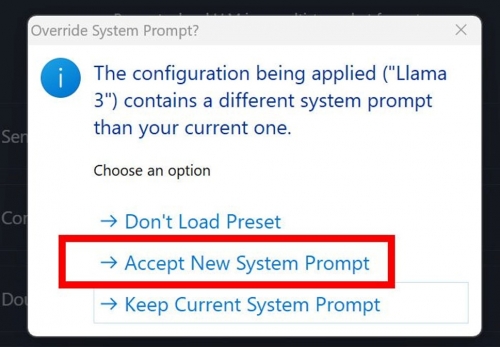

6. 当出现提示时,选择“Accept New System Prompt(接受新系统提示)”。

7. 如果您使用的是基于AMD Ryzen AI的AI PC,请开始聊天!

对于使用AMD Radeon 7000系列显卡的用户,只有几个额外的步骤:

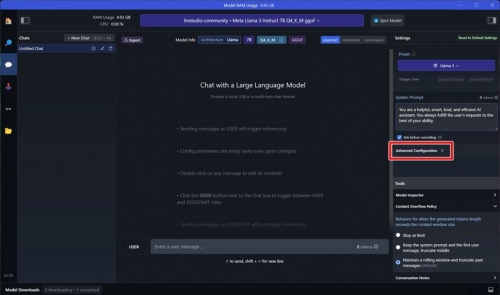

8. 点击右侧的“高级配置(Advanced Configuration)”。

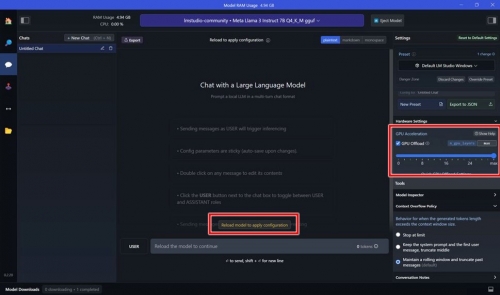

9. 向下滚动,直到看到“Hardware Settings(硬件设置)”。确保选择“GPU Offload(卸载)”,并且滑块一直向右(最大值)。如果出现提示,点击“Reload model to apply configuration(重新加载模型以应用配置)”。

10. 开始与Meta的新Llama 3聊天机器人聊天。

就是这么简单。